Apple L’analyse CSAM des photos controversées d’iCloud retardée

Apple Annoncées vendredi, les versions d’automne d’iOS 15, d’iPadOS 15, de watchOS 8 et de macOS 12 Monterey n’offriront pas trois fonctionnalités qu’elle a divulguées pour arrêter la propagation de matériel d’abus sexuel d’enfants (CSAM). La société fournira la fonctionnalité CSAM « dans une mise à jour plus tard cette année ».

Dans le communiqué de presse, Apple « Ce projet est ambitieux et la protection des enfants est une responsabilité importante. Ces efforts se développeront et s’étendront au fil du temps », indique le communiqué.

Apple Les capacités de CSAM ont été annoncées début août, et de nombreux acteurs du monde de la technologie ont applaudi les efforts d’Apple pour protéger les enfants, beaucoup exprimant également des inquiétudes quant à la façon dont la technologie derrière les capacités de CSAM pourrait potentiellement être utilisée à d’autres fins de surveillance.Plus de 90 groupes politiques et de défense des droits publient une lettre ouverte exhortant Apple Annulez sa fonction CSAM.

La principale fonctionnalité en cause est la fonction de détection CSAM, qui analyse les hachages d’images sur votre appareil, puis vérifie ces hachages par rapport à une liste de hachages CSAM connus. L’argument contre cette fonctionnalité est qu’elle peut être utilisée à d’autres fins.Par exemple, le gouvernement peut exiger Apple Créer un processus similaire pour examiner les images jugées décisives pour la politique gouvernementale.

Apple a déclaré qu’il refuserait une telle demande dans les circonstances, mais la déclaration n’a pas renforcé la confiance des parties concernées.Le gouvernement peut (et aura) toujours des conséquences s’il ne suit pas les ordres, ce qui peut conduire à Apple changer sa politique.Une autre possibilité est Apple La décision pourrait être prise d’utiliser la technologie à d’autres fins que CSAM, bien que cela nuirait à l’image d’Apple en tant qu’entreprise soucieuse de la confidentialité des utilisateurs.

Les deux autres fonctions CSAM différées sont :

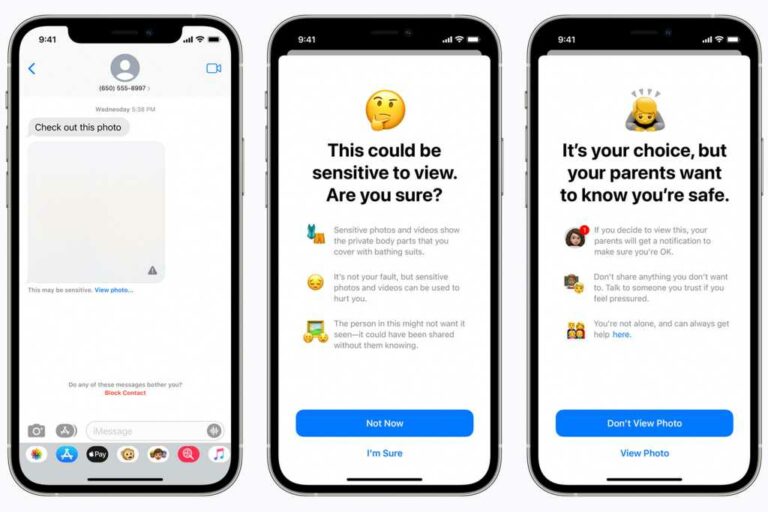

- Sécurité de la communication des messages : L’application Messages utilisera l’apprentissage automatique sur l’appareil pour avertir les enfants et les parents du contenu sensible.

- Siri et Recherche : Ces fonctionnalités fourniront des ressources supplémentaires pour aider les enfants et les parents à rester en sécurité en ligne et à obtenir de l’aide dans des situations dangereuses.

Notre FAQ sur la détection de CSAM contient plus d’informations sur ces fonctionnalités, y compris des explications sur leur fonctionnement et la controverse qui en découle.