iOS 15.2 : le scanner d’images nues vise à protéger les enfants

Apple doit suspendre l’analyse controversée de la pornographie juvénile après le tollé des militants de la protection des données Apple La protection des enfants est toujours à l’ordre du jour et fait ses débuts avec iOS 15.2.

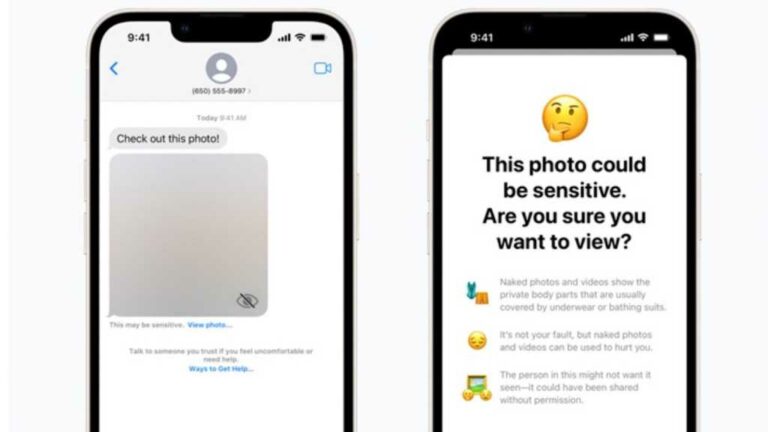

Une nouvelle fonctionnalité a été intégrée à l’application de messagerie visant à protéger les enfants de la réception et de l’envoi de photos nues.

Les parents peuvent configurer les iPhones, iPads et Mac de leurs enfants pour qu’ils reconnaissent les photos nues et avertissent les enfants concernés de ne pas voir et envoyer de tels contenus.

Pour ce faire, il pixellise les images entrantes et affiche un avertissement, des notifications similaires apparaissent lorsque vous essayez d’envoyer de telles images. Cependant, les utilisateurs peuvent balayer la notification et toujours recevoir ou envoyer des images.

lorsque Apple Des plans ont d’abord été annoncés pour informer automatiquement les parents si de telles images étaient envoyées ou reçues. Cependant, cela a légèrement changé et les enfants ont désormais la possibilité de contacter eux-mêmes leurs parents via un bouton dans l’avertissement.

Pour activer pleinement cette fonctionnalité, les parents doivent l’activer dans les paramètres de contrôle parental. Cet opt-in est destiné à répondre aux préoccupations selon lesquelles les autorités ou d’autres tiers pourraient utiliser l’interface à des fins de surveillance.

Apple Siri a également été mis à jour pour rendre plus difficile la recherche de pornographie juvénile et offrir une meilleure assistance aux victimes de violences sexuelles. Lors de la recherche de pédopornographie, les utilisateurs sont également informés de la nature préjudiciable du contenu et des liens affichés pour aider à la prévention.

Cet article a été initialement publié sur Macwelt. Traduit par Karen Haslam.